Terraform으로 EKS 구축하기

31 Mar 2022

이전 글에서는 ECS / EKS에서 서비스 하는 것에 대한 개념을 풀어 써봤습니다. 이번 글에서는 잘 만들어진 모듈을 이용해 빠르게 구성해보겠습니다.

모듈을 이용하면 편하긴 하지만 내부 개념을 정확히 이해하지 못한 채 사용하면 문제가 발생했을 때 해결이 어려운 것 같습니다. 결국 기본이 중요하다고 생각합니다.

VPC 셋업

VPC 모듈을 사용하면 이전에 길게 썼던 것을 짧게 기술할 수 있습니다. 이전에 만든 VPC 구조와 같지만 NAT 게이트웨이가 AZ 별로 따로 존재합니다.

provider "aws" {

region = "ap-northeast-2"

}

locals {

cluster_name = "simon-test"

}

module "vpc" {

source = "terraform-aws-modules/vpc/aws"

name = "simon-test"

cidr = "10.194.0.0/16"

azs = ["ap-northeast-2a", "ap-northeast-2c"]

public_subnets = ["10.194.0.0/24", "10.194.1.0/24"]

private_subnets = ["10.194.100.0/24", "10.194.101.0/24"]

enable_nat_gateway = true

one_nat_gateway_per_az = true

enable_dns_hostnames = true

public_subnet_tags = {

"kubernetes.io/cluster/${local.cluster_name}" = "shared"

"kubernetes.io/role/elb" = "1"

}

private_subnet_tags = {

"kubernetes.io/cluster/${local.cluster_name}" = "shared"

"kubernetes.io/role/internal-elb" = "1"

}

}

EKS 클러스터 생성

AWS EKS 모듈을 사용하면 EKS 클러스터도 쉽게 생성가능합니다.

module "eks" {

source = "terraform-aws-modules/eks/aws"

cluster_name = local.cluster_name

cluster_version = "1.21"

cluster_endpoint_private_access = false

cluster_endpoint_public_access = true

cluster_addons = {

coredns = {

resolve_conflicts = "OVERWRITE"

}

kube-proxy = {}

vpc-cni = {

resolve_conflicts = "OVERWRITE"

}

}

vpc_id = module.vpc.vpc_id

subnet_ids = module.vpc.private_subnets

cloudwatch_log_group_retention_in_days = 1

fargate_profiles = {

default = {

name = "default"

selectors = [

{

namespace = "kube-system"

},

{

namespace = "default"

}

]

}

}

}

coredns 모듈 생성에서 계속 멈춰 있는 것을 볼 수 있습니다. Fargate만 있어서인데, CoreDNS 패치를 해 주면 잠시 후 완료됩니다.

$ aws eks update-kubeconfig --region ap-northeast-2 --name simon-test --alias simon-test

$ kubectl patch deployment coredns -n kube-system --type json -p='[{"op": "remove", "path": "/spec/template/metadata/annotations/eks.amazonaws.com~1compute-type"}]'

AWS Load Balancer Controller 설치

AWS Load Balancer Controller도 Terraform으로 설치가능합니다. 관련된 모듈이 여러 개 있는데 미묘하게 다 동작을 하지 않아서 결국은 자체적으로 구현해봤습니다. 이전에 쉘에서 실행한 명령을 Terraform으로 구성했다고 보시면 됩니다.

locals {

lb_controller_iam_role_name = "inhouse-eks-aws-lb-ctrl"

lb_controller_service_account_name = "aws-load-balancer-controller"

}

data "aws_eks_cluster_auth" "this" {

name = local.cluster_name

}

provider "helm" {

kubernetes {

host = module.eks.cluster_endpoint

token = data.aws_eks_cluster_auth.this.token

cluster_ca_certificate = base64decode(module.eks.cluster_certificate_authority_data)

}

}

module "lb_controller_role" {

source = "terraform-aws-modules/iam/aws//modules/iam-assumable-role-with-oidc"

create_role = true

role_name = local.lb_controller_iam_role_name

role_path = "/"

role_description = "Used by AWS Load Balancer Controller for EKS"

role_permissions_boundary_arn = ""

provider_url = replace(module.eks.cluster_oidc_issuer_url, "https://", "")

oidc_fully_qualified_subjects = [

"system:serviceaccount:kube-system:${local.lb_controller_service_account_name}"

]

oidc_fully_qualified_audiences = [

"sts.amazonaws.com"

]

}

data "http" "iam_policy" {

url = "https://raw.githubusercontent.com/kubernetes-sigs/aws-load-balancer-controller/v2.4.0/docs/install/iam_policy.json"

}

resource "aws_iam_role_policy" "controller" {

name_prefix = "AWSLoadBalancerControllerIAMPolicy"

policy = data.http.iam_policy.body

role = module.lb_controller_role.iam_role_name

}

resource "helm_release" "release" {

name = "aws-load-balancer-controller"

chart = "aws-load-balancer-controller"

repository = "https://aws.github.io/eks-charts"

namespace = "kube-system"

dynamic "set" {

for_each = {

"clusterName" = module.eks.cluster_id

"serviceAccount.create" = "true"

"serviceAccount.name" = local.lb_controller_service_account_name

"region" = "ap-northeast-2"

"vpcId" = module.vpc.vpc_id

"image.repository" = "602401143452.dkr.ecr.ap-northeast-2.amazonaws.com/amazon/aws-load-balancer-controller"

"serviceAccount.annotations.eks\\.amazonaws\\.com/role-arn" = module.lb_controller_role.iam_role_arn

}

content {

name = set.key

value = set.value

}

}

}

어플리케이션 구동

간단한 서버(이번에는 공개 서버 - k8s.gcr.io/echoserver -를 이용합니다)를 Terraform으로 구성하겠습니다.

provider "kubernetes" {

host = module.eks.cluster_endpoint

token = data.aws_eks_cluster_auth.this.token

cluster_ca_certificate = base64decode(module.eks.cluster_certificate_authority_data)

}

resource "kubernetes_deployment" "echo" {

metadata {

name = "echo"

}

spec {

replicas = 1

selector {

match_labels = {

"app.kubernetes.io/name" = "echo"

}

}

template {

metadata {

labels = {

"app.kubernetes.io/name" = "echo"

}

}

spec {

container {

image = "k8s.gcr.io/echoserver:1.10"

name = "echo"

}

}

}

}

}

resource "kubernetes_service" "echo" {

metadata {

name = "echo"

}

spec {

selector = {

"app.kubernetes.io/name" = "echo"

}

port {

port = 8080

target_port = 8080

}

type = "NodePort"

}

}

resource "kubernetes_ingress_v1" "alb" {

metadata {

name = "alb"

annotations = {

"alb.ingress.kubernetes.io/scheme" = "internet-facing",

"alb.ingress.kubernetes.io/target-type" = "ip",

}

}

spec {

ingress_class_name = "alb"

rule {

http {

path {

backend {

service {

name = "echo"

port {

number = 8080

}

}

}

path = "/*"

}

}

}

}

}

이제 로드 밸런서 주소로 요청을 보내면 응답을 보내옵니다.

# k8s-default-alb-622014ceba-1089817135.ap-northeast-2.elb.amazonaws.com 같은 주소를 가집니다

$ LB_HOST=$(kubectl get ingress/alb -ojson | jq -r ".status.loadBalancer.ingress[0].hostname")

$ curl $LB_HOST

Hostname: echo-5499565745-tk7dm

Pod Information:

-no pod information available-

Server values:

server_version=nginx: 1.13.3 - lua: 10008

Request Information:

client_address=10.194.1.162

method=GET

real path=/

query=

request_version=1.1

request_scheme=http

request_uri=http://k8s-default-alb-622014ceba-1089817135.ap-northeast-2.elb.amazonaws.com:8080/

Request Headers:

accept=*/*

host=k8s-default-alb-622014ceba-1089817135.ap-northeast-2.elb.amazonaws.com

user-agent=curl/7.77.0

x-amzn-trace-id=Root=1-6244434a-56cbdde1124166e4168d1cf4

x-forwarded-for=1.2.3.4

x-forwarded-port=80

x-forwarded-proto=http

Request Body:

-no body in request-

위 예에서는 같은 Terraform 파일에서 정의를 했기 때문에 module.eks의 출력을 이용했습니다. 만약 별도 스택으로 정의를 할 예정이고, kubeconfig가 설정된 상태면 다음과 같이 provider를 설정할 수 있습니다.

provider "kubernetes" {

config_path = "~/.kube/config"

config_context = "simon-test"

}

후기

EKS 시리즈 글을 작성하면서 클러스터 생성을 여러 번 반복했습니다. 반복할 때마다 하나씩 빼먹어서 문제점을 찾는데 한참 걸렸습니다. 그에 비해 잘 구성된 Terraform 모듈을 활용하니 확실히 편했습니다.

하지만 각 단계를 한번씩 해봐서 전체적인 이해가 된 상황(서브넷 태깅이 왜 필요한지, CoreDNS는 왜 생성되지 않는지등)이여서 모듈 활용도 가능했다고 봅니다.

이번 예에서는 예제 파일을 단순하게 하기 위해서, 쿠버네티스에서 동작하는 어플리케이션까지 Terraform으로 구성해봤습니다. Terraform으로 인프라를 통일하면 좋다고 생각하지만, 쿠버네티스는 별개의 정의 스펙이 있다보니 애매한 점이 있는 것 같습니다. 실제로 저희 실 서비스의 경우는 Terraform이 아니라 Helm Charts를 사용해 어플리케이션을 정의했습니다.

이번 글이 쿠버네티스와 EKS를 이해하는데 도움이 되었기를 바랍니다.

Appendix

EKS를 사용해서 어플리케이션 서비스 하기

31 Mar 2022

ECS 아티클에 이어 이번 글에서는 같은 서비스를 EKS로 구축해보도록 하겠습니다.

간단하게 구축하는 것은 eksctl을 쓰면 되지만, 내부 이해를 위해 여기서는 기본부터 구현하도록 하겠습니다.

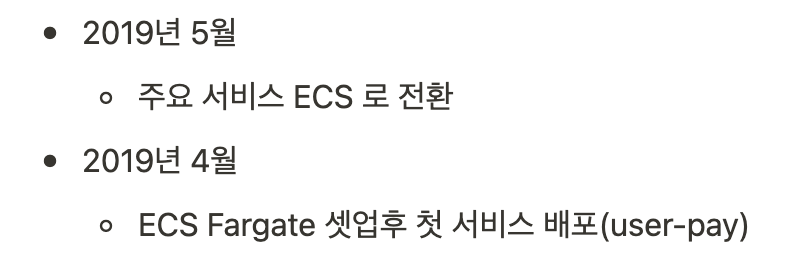

VPC 셋업

VPC는 이전과 마찬가지로 두 개의 AZ에 퍼블릭 서브넷과 프리이빗 서브넷이 필요합니다. 다만 로드 밸런서가 정상적으로 배치되려며 특정한 태그를 서브넷에 부여해야합니다.

서비스 컨테이너만 정의하는 ECS와 달리 쿠버네티스는 클러스터 내에서 로드 밸런서, 영구 볼륨등도 정의할 수 있습니다. 이때 정의는 쿠버네티스안에서 하지만 실제 만들어지는 것은 쿠버네티스와 무관한 AWS 리소스(ALB, EBS등)입니다. 쿠버네티스 자체는 AWS 구조와 독립적이고, 태그등 다른 방법을 통해 쿠버네티스 리소스가 위치할 AWS 리소스를 찾게 됩니다.

EKS에서 애플리케이션 로드 밸런싱 문서에 따라 다음 태그를 설정해줍니다.

kubernetes.io/cluster/<name>:sharedkubernetes.io/role/internal-elb: 프라이빗 서브넷에 대해1로 설정합니다.kubernetes.io/role/elb: 퍼블릭 서브넷에 대해1로 설정합니다.

provider "aws" {

region = "ap-northeast-2"

}

locals {

vpc_name = "simon-test"

cidr = "10.194.0.0/16"

public_subnets = ["10.194.0.0/24", "10.194.1.0/24"]

private_subnets = ["10.194.100.0/24", "10.194.101.0/24"]

azs = ["ap-northeast-2a", "ap-northeast-2c"]

cluster_name = "simon-test"

}

## VPC를 생성합니다

resource "aws_vpc" "this" {

cidr_block = local.cidr

tags = { Name = local.vpc_name }

}

## VPC 생성시 기본으로 생성되는 라우트 테이블에 이름을 붙입니다

## 이걸 서브넷에 연결해 써도 되지만, 여기서는 사용하지 않습니다

resource "aws_default_route_table" "this" {

default_route_table_id = aws_vpc.this.default_route_table_id

tags = { Name = "${local.vpc_name}-default" }

}

## VPC 생성시 기본으로 생성되는 보안 그룹에 이름을 붙입니다

resource "aws_default_security_group" "this" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-default" }

}

## 퍼플릭 서브넷에 연결할 인터넷 게이트웨이를 정의합니다

resource "aws_internet_gateway" "this" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-igw" }

}

## 퍼플릭 서브넷에 적용할 라우팅 테이블

resource "aws_route_table" "public" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-public" }

}

## 퍼플릭 서브넷에서 인터넷에 트래픽 요청시 앞서 정의한 인터넷 게이트웨이로 보냅니다

resource "aws_route" "public_worldwide" {

route_table_id = aws_route_table.public.id

destination_cidr_block = "0.0.0.0/0"

gateway_id = aws_internet_gateway.this.id

}

## 퍼플릭 서브넷을 정의합니다

resource "aws_subnet" "public" {

count = length(local.public_subnets) # 여러개를 정의합니다

vpc_id = aws_vpc.this.id

cidr_block = local.public_subnets[count.index]

availability_zone = local.azs[count.index]

map_public_ip_on_launch = true # 퍼플릭 서브넷에 배치되는 서비스는 자동으로 공개 IP를 부여합니다

tags = {

Name = "${local.vpc_name}-public-${count.index + 1}",

"kubernetes.io/cluster/${local.cluster_name}" = "shared", # 다른 부분

"kubernetes.io/role/elb" = "1" # 다른 부분

}

}

## 퍼플릭 서브넷을 라우팅 테이블에 연결합니다

resource "aws_route_table_association" "public" {

count = length(local.public_subnets)

subnet_id = aws_subnet.public[count.index].id

route_table_id = aws_route_table.public.id

}

## NAT 게이트웨이는 고정 IP를 필요로 합니다

resource "aws_eip" "nat_gateway" {

vpc = true

tags = { Name = "${local.vpc_name}-natgw" }

}

## 프라이빗 서브넷에서 인터넷 접속시 사용할 NAT 게이트웨이

resource "aws_nat_gateway" "this" {

allocation_id = aws_eip.nat_gateway.id

subnet_id = aws_subnet.public[0].id # NAT 게이트웨이 자체는 퍼플릭 서브넷에 위치해야 합니다

tags = { Name = "${local.vpc_name}-natgw" }

}

## 프라이빗 서브넷에 적용할 라우팅 테이블

resource "aws_route_table" "private" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-private" }

}

## 프라이빗 서브넷에서 인터넷에 트래픽 요청시 앞서 정의한 NAT 게이트웨이로 보냅니다

resource "aws_route" "private_worldwide" {

route_table_id = aws_route_table.private.id

destination_cidr_block = "0.0.0.0/0"

nat_gateway_id = aws_nat_gateway.this.id

}

## 프라이빗 서브넷을 정의합니다

resource "aws_subnet" "private" {

count = length(local.private_subnets) # 여러개를 정의합니다

vpc_id = aws_vpc.this.id

cidr_block = local.private_subnets[count.index]

availability_zone = local.azs[count.index]

tags = {

Name = "${local.vpc_name}-private-${count.index + 1}",

"kubernetes.io/cluster/${local.cluster_name}" = "shared", # 다른 부분

"kubernetes.io/role/internal-elb" = "1" # 다른 부분

}

}

## 프라이빗 서브넷을 라우팅 테이블에 연결합니다

resource "aws_route_table_association" "private" {

count = length(local.private_subnets)

subnet_id = aws_subnet.private[count.index].id

route_table_id = aws_route_table.private.id

}

EKS 클러스터 생성

ECS가 하나의 리소스로 끝난 것에 비해 EKS는 조금 복잡합니다.

## 클러스터가 사용할 역할을 정의합니다.

## AmazonEKSClusterPolicy와 AmazonEKSVPCResourceController를 포함합니다.

resource "aws_iam_role" "cluster" {

name = "${local.cluster_name}-eks-cluster-role"

assume_role_policy = jsonencode({

Version = "2012-10-17",

Statement = [{

Effect = "Allow",

Principal = {

Service = "eks.amazonaws.com"

},

Action = "sts:AssumeRole"

}]

})

}

resource "aws_iam_role_policy_attachment" "cluster_AmazonEKSClusterPolicy" {

policy_arn = "arn:aws:iam::aws:policy/AmazonEKSClusterPolicy"

role = aws_iam_role.cluster.name

}

resource "aws_iam_role_policy_attachment" "cluster_AmazonEKSVPCResourceController" {

policy_arn = "arn:aws:iam::aws:policy/AmazonEKSVPCResourceController"

role = aws_iam_role.cluster.name

}

## EKS 클러스터를 정의합니다

resource "aws_eks_cluster" "this" {

name = local.cluster_name

role_arn = aws_iam_role.cluster.arn

vpc_config {

subnet_ids = aws_subnet.private[*].id

}

depends_on = [ # see https://registry.terraform.io/providers/hashicorp/aws/latest/docs/resources/eks_cluster#example-usage

aws_iam_role_policy_attachment.cluster_AmazonEKSClusterPolicy,

aws_iam_role_policy_attachment.cluster_AmazonEKSVPCResourceController,

]

}

## Fargate에서 팟 배치시 사용하는 실행 역할을 정의합니다.

## AmazonEKSFargatePodExecutionRolePolicy를 포함합니다.

resource "aws_iam_role" "pod_execution" {

name = "${local.cluster_name}-eks-pod-execution-role"

assume_role_policy = jsonencode({

Version = "2012-10-17",

Statement = [{

Effect = "Allow",

Principal = {

Service = "eks-fargate-pods.amazonaws.com"

},

Action = "sts:AssumeRole"

}]

})

}

resource "aws_iam_role_policy_attachment" "pod_execution_AmazonEKSFargatePodExecutionRolePolicy" {

policy_arn = "arn:aws:iam::aws:policy/AmazonEKSFargatePodExecutionRolePolicy"

role = aws_iam_role.pod_execution.name

}

## EKS 클러스터에 노드를 Fargate로 공급합니다.

## default/kube-system 네임스페이스를 가진 팟에 대해 적용됩니다.

resource "aws_eks_fargate_profile" "default" {

cluster_name = aws_eks_cluster.this.name

fargate_profile_name = "fp-default"

pod_execution_role_arn = aws_iam_role.pod_execution.arn

subnet_ids = aws_subnet.private[*].id # 프라이빗 서브넷만 줄 수 있습니다.

selector {

namespace = "default"

}

selector {

namespace = "kube-system"

}

}

쿠버네티스 클러스터에 접근할 수 있도록 kubeconfig를 생성합니다.

$ aws eks update-kubeconfig --region ap-northeast-2 --name simon-test --alias simon-test

이제 쿠버네티스 클러스터의 상태를 볼 수 있습니다.

$ kubectl get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

kubernetes ClusterIP 172.20.0.1 <none> 443/TCP 23m

그런데 팟 목록을 보면 기본적으로 실행되어야 할 coredns 팟이 뜨지 않는 것이 보입니다.

$ kubectl get pods -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-6dbb778559-clx8r 0/1 Pending 0 13m

coredns-6dbb778559-zpx2h 0/1 Pending 0 13m

Fargate 노드만 사용하려면 CoreDNS 내용을 수정 해줘야 합니다.

$ kubectl patch deployment coredns \

-n kube-system \

--type json \

-p='[{"op": "remove", "path": "/spec/template/metadata/annotations/eks.amazonaws.com~1compute-type"}]'

deployment.apps/coredns patched

$ kubectl get pods -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-6f99dbb876-hp667 1/1 Running 0 4m

coredns-6f99dbb876-skrgn 1/1 Running 0 4m

컨테이너에 IAM 권한을 부여하려면 OIDC 공급자 생성이 필요합니다

$ eksctl utils associate-iam-oidc-provider --cluster simon-test --approve

서비스 구동

이제 우리가 만든 어플리케이션을 EKS 클러스터에 올릴 차례입니다.

이전과 마찬가지로 ECR 저장소를 만들고 이미지를 올려둡니다.

locals {

app_name = "simon-sample"

}

## simon-sample 앱을 위한 저장소를 만듭니다

resource "aws_ecr_repository" "simon_sample" {

name = local.app_name

}

이 이미지를 띄우는 것은 쿠버네티스가 처리합니다.

쿠버네티스에 띄우는 가장 작은 단위는 파드입니다. 다만 파드로 띄우면 서버를 확장하는 것이 어렵습니다. 레플리카셋이라는 리소스를 사용하면 파드를 여러개 띄울 수 있습니다. 여기에 더해 디플로이먼트를 리소스를 사용하면 어플리케이션 갱신시 레플리카셋 교체를 해줍니다.

다음과 같이 쿠버네티스 리소스를 정의합니다.

apiVersion: apps/v1

kind: Deployment

metadata:

name: simon-sample

spec:

replicas: 1

selector:

matchLabels:

app: simon-sample

template:

metadata:

labels:

app: simon-sample

spec:

containers:

- name: app

image: <aws-account-id>.dkr.ecr.ap-northeast-2.amazonaws.com/simon-sample:latest

ports:

- containerPort: 3000

다음 명령으로 적용합니다.

$ kubectl apply -f simon-sample.yaml

deployment.apps/simon-sample created

보통 5분 안에(빠르면 1분 안에) 다음과 같이 Running 상태로 바뀝니다.

$ kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

simon-sample-dd88b97bc-svtd6 1/1 Running 0 3m45s 10.194.101.15 fargate-10.194.101.15 <none> <none>

포트 포워딩으로 세팅하고, HTTP 요청을 하면 응답이 오는 것을 볼 수 있습니다.

$ kubectl port-forward simon-sample-dd88b97bc-svtd6 3000:3000

Forwarding from 127.0.0.1:3000 -> 3000

Handling connection for 3000

## from other terminal

$ curl localhost:3000 --data 'hello world'

hello world

서비스를 외부에 노출하기

ECS와 마찬가지로 실제 서비스가 되려면 외부에 노출된 로드 밸런서에 우리의 서비스를 붙여줘야 합니다. ECS와 달리 쿠버네티스에서는 로드 밸런서 정의도 쿠버네티스 리소스로 정의합니다. 하지만 실제로는 EKS가 알아서 AWS 로드 밸런서를 생성하게 됩니다.

어플리케이션 계층(L7)에서 동작하는 Application Load Balancer(ALB)를 생성하기 위한 리소스 타입은 Ingress 입니다.

우선 AWS Load Balancer Controller 추가 기능 설치가 필요합니다.

## ALB를 컨트롤 할 수 있는 정책을 생성합니다.

$ curl -o iam_policy.json https://raw.githubusercontent.com/kubernetes-sigs/aws-load-balancer-controller/v2.4.0/docs/install/iam_policy.json

$ aws iam create-policy \

--policy-name AWSLoadBalancerControllerIAMPolicy-simon-test \

--policy-document file://iam_policy.json

## 위 정책을 포함한 IAM 역할을 생성합니다.

$ ACCOUNT_ID=$(aws sts get-caller-identity | jq -r .Account)

$ OIDC_URL=$(aws eks describe-cluster --name simon-test --query "cluster.identity.oidc.issuer" --output text | sed "s|https://||")

$ cat > load-balancer-role-trust-policy.json << EOF

{

"Version": "2012-10-17",

"Statement": [

{

"Effect": "Allow",

"Principal": {

"Federated": "arn:aws:iam::${ACCOUNT_ID}:oidc-provider/$OIDC_URL"

},

"Action": "sts:AssumeRoleWithWebIdentity",

"Condition": {

"StringEquals": {

"${OIDC_URL}:aud": "sts.amazonaws.com",

"${OIDC_URL}:sub": "system:serviceaccount:kube-system:aws-load-balancer-controller"

}

}

}

]

}

EOF

$ aws iam create-role \

--role-name AmazonEKSLoadBalancerControllerRole-simon-test \

--assume-role-policy-document file://"load-balancer-role-trust-policy.json"

$ aws iam attach-role-policy \

--policy-arn arn:aws:iam::${ACCOUNT_ID}:policy/AWSLoadBalancerControllerIAMPolicy-simon-test \

--role-name AmazonEKSLoadBalancerControllerRole-simon-test

## IAM 역할에 연결된 쿠베네티스 서비스 계정을 생성합니다.

$ cat > aws-load-balancer-controller-service-account.yaml << EOF

apiVersion: v1

kind: ServiceAccount

metadata:

labels:

app.kubernetes.io/component: controller

app.kubernetes.io/name: aws-load-balancer-controller

name: aws-load-balancer-controller

namespace: kube-system

annotations:

eks.amazonaws.com/role-arn: arn:aws:iam::${ACCOUNT_ID}:role/AmazonEKSLoadBalancerControllerRole-simon-test

EOF

$ kubectl apply -f aws-load-balancer-controller-service-account.yaml

## AWS Load Balancer Controller를 설치합니다

$ VPC_ID=$(aws ec2 describe-vpcs --filters Name=cidr,Values=10.194.0.0/16 | jq -r .Vpcs[0].VpcId)

$ helm repo add eks https://aws.github.io/eks-charts

$ helm repo update

$ helm install aws-load-balancer-controller eks/aws-load-balancer-controller \

-n kube-system \

--set clusterName=simon-test \

--set serviceAccount.create=false \

--set serviceAccount.name=aws-load-balancer-controller \

--set region=ap-northeast-2 \

--set vpcId=$VPC_ID \

--set image.repository=602401143452.dkr.ecr.ap-northeast-2.amazonaws.com/amazon/aws-load-balancer-controller

NAME: aws-load-balancer-controller

LAST DEPLOYED: Sat Mar 26 10:02:19 2022

NAMESPACE: kube-system

STATUS: deployed

REVISION: 1

TEST SUITE: None

NOTES:

AWS Load Balancer controller installed!

$ kubectl get deployment -n kube-system aws-load-balancer-controller

NAME READY UP-TO-DATE AVAILABLE AGE

aws-load-balancer-controller 2/2 2 2 5m51s

이제 쿠버네티스를 통해 ALB를 생성하고, 아까 만든 앱을 등록합니다.

apiVersion: v1

kind: Service

metadata:

name: simon-sample-service

spec:

ports:

- port: 3000

targetPort: 3000

protocol: TCP

type: NodePort

selector:

app: simon-sample

---

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: simon-test-alb

annotations:

alb.ingress.kubernetes.io/scheme: internet-facing

alb.ingress.kubernetes.io/target-type: ip

spec:

ingressClassName: alb

rules:

- http:

paths:

- path: /

pathType: Prefix

backend:

service:

name: simon-sample-service

port:

number: 3000

이제 로드 밸런서 주소로 요청을 보내면 응답을 보내옵니다.

## k8s-default-simontes-ea5ab2759b-771587743.ap-northeast-2.elb.amazonaws.com 같은 주소를 가집니다

$ LB_HOST=$(kubectl get ingress/simon-test-alb -ojson | jq -r .status.loadBalancer.ingress[0].hostname)

$ curl $LB_HOST --data 'hello world'

hello world

후기

확실히 EKS는 ECS에 비해 훨씬 복잡합니다. 그만큼 세세한 컨트롤이 가능하고, AWS에 특화된 개념이 아니라는 것은 장점이라고 봅니다.

이번 글에서는 수동으로 처리해주는 부분이 꽤 있는데 다음에는 더 자동화(Terraform) 해보도록 하겠습니다.

Appendix

ECS를 사용해서 어플리케이션 서비스 하기

31 Mar 2022

카카오스타일에서는 한동한 ECS를 사용해서 어플리케이션을 서비스했습니다. 현재는 EKS로 전환하고 있지만, ECS가 상대적으로 단순하기 때문에 서비스 구축 개념을 익히는데 좋은 것 같습니다. (간단한 서비스는 굳이 쿠버네티스를 쓸 필요가 없다고 생각합니다) 그런 의미에서 이번 글에서는 ECS를 이용해 단순한 서비스를 오픈하는 과정을 단계별로 설명해보려고 합니다.

Docker 도입 과정

도커에 대한 얘기는 2014~2015년 무렵 들려오기 시작했던 것 같습니다. 혁신적인 솔루션이라는 얘기가 오가고 있었지만, 카카오스타일에서는 AWS Elastic Beanstalk를 거쳐, 독자적인 배포 시스템을 갖추고 있었기 때문에 도커의 이득에 대해서 크게 와 닿지 않아 도커로 넘어가는게 상대적으로 늦었던 것 같습니다.

그러던 와중에 처음 필요성을 느꼈던 것은 로컬 개발환경을 갖추는 부분이였던 것 같습니다. 유닛 테스트등을 위해서 로컬에 DB 프로세스 구동이 필요했습니다. 신규 직원에게 brew로 설치하는 것을 가이드하고 있었는데, Docker Compose로 구성해두었더니 도커에 익숙한 사람은 쉽게 개발 환경을 갖출 수 있었습니다.

이후 지토가 하나의 마이크로서비스에 대해서 ECS 셋업을 했는데, 세팅된 것을 보고 나니 유용성이 느껴진 것 같습니다. 그래서 빠르게 이후에 빠르게 ECS 전환을 했습니다.

ECS 전환전보다 배포 시간이 늘어나긴 했습니다. (이전에는 이미 존재하는 EC2 인스턴스에 새로운 소스를 전송한 후 프로세스만 새로 띄우면 됐습니다) 하지만 점점 마이크로서비스로 나눠지고, 트래픽이 늘어나는 상황에 대응하기에는 ECS가 훨씬 수월했습니다.

Docker로 서비스 만들기

도커로 구동할 Node.js 어플리케이션을 만들어봅시다. HTTP 요청에 보낸 온 데이터를 그대로 반환하는 간단한 서버입니다.

// echo.js

const http = require('http');

const server = http.createServer((req, res) => {

req.pipe(res);

});

server.listen(3000);

이 서버를 도커 이미지로 만들기 위해 다음과 같이 Dockerfile을 만들면 됩니다.

FROM node:16

WORKDIR /opt/app

COPY echo.js .

EXPOSE 3000

CMD ["node", "echo.js"]

[docker build](https://docs.docker.com/engine/reference/commandline/build/)로 도커 이미지를 만들 수 있습니다.

$ docker build . -t simon-sample

Apple Silicon을 사용한 컴퓨터에서는 platform을 지정해 빌드해야 ECS에서 정상동작합니다.

docker build . -t simon-sample --platform=linux/amd64

[docker run](https://docs.docker.com/engine/reference/commandline/run/)을 이용해 이미지로 부터 프로세스를 실행할 수 있습니다. 외부에서 서버에 접근하기 위해 3000번 포트를 열어야 하고, 데몬 모드로 실행합니다.

$ docker run -p 3000 -d simon-sample

curl을 사용해 잘 동작하는지 확인 가능합니다.

$ curl http://localhost:3000 --data 'hello world'

hello world

이렇게 만들어진 이미지는 어떠한 환경에서든 동일하게 동작하고, 배포도 단순해집니다.

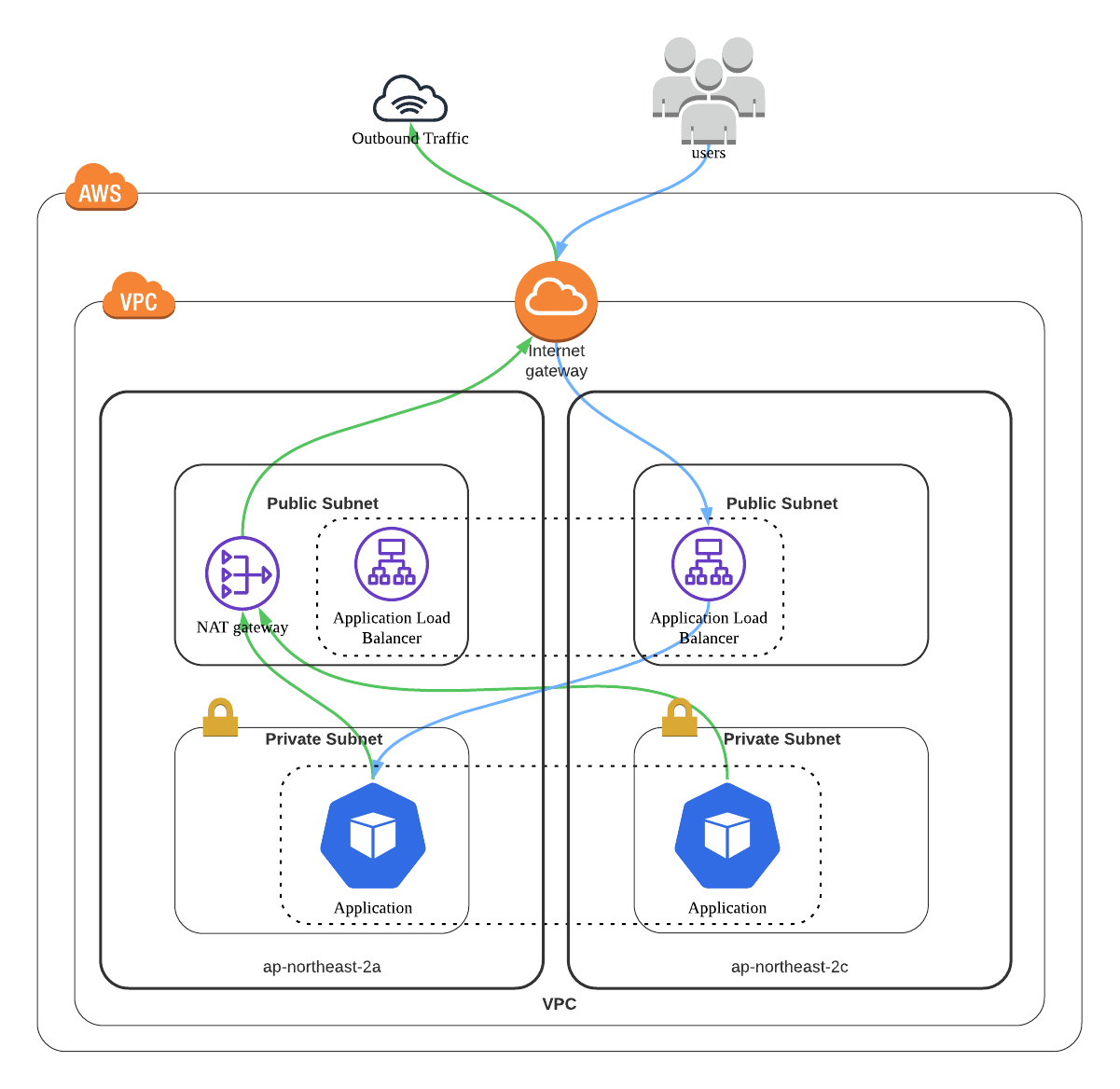

VPC 셋업

ECS 클러스터 생성에 앞서, 클러스터가 놓일 VPC를 만듭니다.

우리가 원하는 서비스 구조를 위해서는 VPC에 최소한 다음과 같은 것들이 필요합니다. (퍼블릭 및 프라이빗 서브넷이 있는 VPC(NAT) 문서에서 설명하는 구조와 같습니다.)

- VPC

- 인터넷에 노출되는 서버가 놓일 퍼플릭 서브넷 (최소 두개 이상의 AZ)

- 안전하게 외부로 부터 접근을 차단된, 실제 서비스가 배치될 프라이빗 서브넷 (최소 두개 이상의 AZ)

- 퍼플릭 서브넷에서 외부 통신을 할 때 사용하는 인터넷 게이트웨이

- 프라이빗 서브넷에서 외부 통신이 필요할 때(아웃바운드 전용) 사용하는 NAT 게이트웨이

- 퍼플릭 서브넷에 연결할 라우팅 테이블. 서브넷에서 다른 서브넷에 접근할 때 규칙과, 외부(0.0.0.0/0)에 접근할 때의 규칙(인터넷 게이트웨이를 거치게 함)을 정의합니다.

- 프라이빗 서브넷에 연결할 라우팅 테이블. 퍼플릭 라우팅 테이블과 비슷한 규칙이지만, 외부에 접근시 NAT 게이트웨이를 거칩니다.

카카오스타일은 인프라 정의시 Terraform을 사용합니다. 여기서는 세부 사항을 이해하기 위해 개별 리소스를 정의하고 있지만, terraform-aws-modules/vpc/aws 같은 모듈을 써서 편하게 정의하는 것도 가능합니다.

provider "aws" {

region = "ap-northeast-2"

}

locals {

vpc_name = "simon-test"

cidr = "10.194.0.0/16"

public_subnets = ["10.194.0.0/24", "10.194.1.0/24"]

private_subnets = ["10.194.100.0/24", "10.194.101.0/24"]

azs = ["ap-northeast-2a", "ap-northeast-2c"]

}

## VPC를 생성합니다

resource "aws_vpc" "this" {

cidr_block = local.cidr

tags = { Name = local.vpc_name }

}

## VPC 생성시 기본으로 생성되는 라우트 테이블에 이름을 붙입니다

## 이걸 서브넷에 연결해 써도 되지만, 여기서는 사용하지 않습니다

resource "aws_default_route_table" "this" {

default_route_table_id = aws_vpc.this.default_route_table_id

tags = { Name = "${local.vpc_name}-default" }

}

## VPC 생성시 기본으로 생성되는 보안 그룹에 이름을 붙입니다

resource "aws_default_security_group" "this" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-default" }

}

## 퍼플릭 서브넷에 연결할 인터넷 게이트웨이를 정의합니다

resource "aws_internet_gateway" "this" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-igw" }

}

## 퍼플릭 서브넷에 적용할 라우팅 테이블

resource "aws_route_table" "public" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-public" }

}

## 퍼플릭 서브넷에서 인터넷에 트래픽 요청시 앞서 정의한 인터넷 게이트웨이로 보냅니다

resource "aws_route" "public_worldwide" {

route_table_id = aws_route_table.public.id

destination_cidr_block = "0.0.0.0/0"

gateway_id = aws_internet_gateway.this.id

}

## 퍼플릭 서브넷을 정의합니다

resource "aws_subnet" "public" {

count = length(local.public_subnets) # 여러개를 정의합니다

vpc_id = aws_vpc.this.id

cidr_block = local.public_subnets[count.index]

availability_zone = local.azs[count.index]

map_public_ip_on_launch = true # 퍼플릭 서브넷에 배치되는 서비스는 자동으로 공개 IP를 부여합니다

tags = { Name = "${local.vpc_name}-public-${count.index + 1}" }

}

## 퍼플릭 서브넷을 라우팅 테이블에 연결합니다

resource "aws_route_table_association" "public" {

count = length(local.public_subnets)

subnet_id = aws_subnet.public[count.index].id

route_table_id = aws_route_table.public.id

}

## NAT 게이트웨이는 고정 IP를 필요로 합니다

resource "aws_eip" "nat_gateway" {

vpc = true

tags = { Name = "${local.vpc_name}-natgw" }

}

## 프라이빗 서브넷에서 인터넷 접속시 사용할 NAT 게이트웨이

resource "aws_nat_gateway" "this" {

allocation_id = aws_eip.nat_gateway.id

subnet_id = aws_subnet.public[0].id # NAT 게이트웨이 자체는 퍼플릭 서브넷에 위치해야 합니다

tags = { Name = "${local.vpc_name}-natgw" }

}

## 프라이빗 서브넷에 적용할 라우팅 테이블

resource "aws_route_table" "private" {

vpc_id = aws_vpc.this.id

tags = { Name = "${local.vpc_name}-private" }

}

## 프라이빗 서브넷에서 인터넷에 트래픽 요청시 앞서 정의한 NAT 게이트웨이로 보냅니다

resource "aws_route" "private_worldwide" {

route_table_id = aws_route_table.private.id

destination_cidr_block = "0.0.0.0/0"

nat_gateway_id = aws_nat_gateway.this.id

}

## 프라이빗 서브넷을 정의합니다

resource "aws_subnet" "private" {

count = length(local.private_subnets) # 여러개를 정의합니다

vpc_id = aws_vpc.this.id

cidr_block = local.private_subnets[count.index]

availability_zone = local.azs[count.index]

tags = { Name = "${local.vpc_name}-private-${count.index + 1}" }

}

## 프라이빗 서브넷을 라우팅 테이블에 연결합니다

resource "aws_route_table_association" "private" {

count = length(local.private_subnets)

subnet_id = aws_subnet.private[count.index].id

route_table_id = aws_route_table.private.id

}

ECS 클러스터

우리 서비스가 동작할 ECS 클러스터가 필요합니다. 도커 컨테이너가 구동될 EC2 인스턴스를 직접 관리한다면 복잡하지만 Fargate를 쓴다면 크게 신경쓸게 없습니다.

## ECS 클러스터를 생성합니다

resource "aws_ecs_cluster" "this" {

name = "simon-test"

}

서비스 구동

이제 우리가 만든 어플리케이션을 ECS 클러스터에 올릴 차례입니다.

우선 도커 이미지를 업로드할 저장소(ECR)를 정의합니다.

locals {

app_name = "simon-sample"

}

## simon-sample 앱을 위한 저장소를 만듭니다

resource "aws_ecr_repository" "simon_sample" {

name = local.app_name

}

첫단계에서 만든 도커 이미지를 다음과 같이 업로드할 수 있습니다.

## ECR 저장소에 로그인합니다

$ aws ecr get-login-password --region ap-northeast-2 | docker login --username AWS --password-stdin <aws-account-id>.dkr.ecr.ap-northeast-2.amazonaws.com

## 앞서 만든 이미지에 ECR 이름을 붙여줍니다

$ docker tag simon-sample:latest <aws-account-id>.dkr.ecr.ap-northeast-2.amazonaws.com/simon-sample:latest

## 이미지를 올립니다

$ docker push <aws-account-id>.dkr.ecr.ap-northeast-2.amazonaws.com/simon-sample:latest

작업 정의를 다음과 같이 정의합니다.

## 태스크 정의시 AmazonECSTaskExecutionRolePolicy 정책을 포함한

## IAM 역할을 실행 역할(execution role)로 설정해줘야 합니다

resource "aws_iam_role" "execution" {

name = "${local.app_name}-exec-role"

assume_role_policy = jsonencode({

Version = "2012-10-17",

Statement = [{

Action = "sts:AssumeRole",

Principal = {

Service = "ecs-tasks.amazonaws.com"

},

Effect = "Allow",

}]

})

}

resource "aws_iam_role_policy_attachment" "execution" {

role = aws_iam_role.execution.name

policy_arn = "arn:aws:iam::aws:policy/service-role/AmazonECSTaskExecutionRolePolicy"

}

## ECS 위에서 띄울 태스크에 대한 정의입니다

resource "aws_ecs_task_definition" "this" {

family = local.app_name

network_mode = "awsvpc"

requires_compatibilities = ["FARGATE"]

cpu = 256 # CPU, 메모리는 가장 작은 값을 사용합니다

memory = 512

execution_role_arn = aws_iam_role.execution.arn

container_definitions = jsonencode([{

name = "app"

image = "${aws_ecr_repository.simon_sample.repository_url}:latest", # ECR에 올라온 이미지를 사용합니다

cpu = 0

portMappings = [{ # 3000번 포트를 외부에 엽니다

hostPort = 3000

protocol = "tcp"

containerPort = 3000

}]

}])

}

이제 컨테이너를 띄울 준비가 끝났습니다. 서비스를 정의하면 설정된 것에 맞춰 작업(태스크)가 뜹니다

## ECR에서 데이터를 가져오려면 태스크에 인터넷에 접근할 수 있는 권한을 주어야 합니다

resource "aws_security_group" "this" {

name = "${local.app_name}-sg"

vpc_id = aws_vpc.this.id

egress {

from_port = 0

to_port = 0

protocol = "-1"

cidr_blocks = ["0.0.0.0/0"]

}

}

## ECS 서비스를 정의합니다

resource "aws_ecs_service" "this" {

desired_count = 1 # 태스크를 하나만 띄웁니다

name = local.app_name

cluster = aws_ecs_cluster.this.arn

task_definition = aws_ecs_task_definition.this.arn

launch_type = "FARGATE"

network_configuration {

subnets = aws_subnet.private[*].id # 프라이빗 서브넷에 배치합니다

security_groups = [aws_security_group.this.id]

}

}

서비스를 외부에 노출하기

이렇게 만들어진 서비스는 외부에서 접속이 불가능하기 때문에 사실 아무 쓸모가 없습니다. (로그도 없어서 잘 떴는지 확인하기도 어렵습니다.)

ECS 태스크를 직접 외부에 노출할 수도 있겠지만, 보통 여러개의 태스크를 실행하기 때문에 앞에 트래픽을 분산해주는 서버가 필요합니다. 이는 로드 밸런서를 이용해 달성할 수 있습니다. 이 로드 밸런서를 퍼블릭 서브넷에 배치함으로써 외부에서 트래픽도 받을 수 있습니다.

3000번 포트로 트래픽을 전송하는 로드밸런서 타겟 그룹을 만들어 로드 밸런서 80포트(HTTP)로 트래픽이 들어오면 전송하도록 설정합니다.

locals {

lb_name = "simon-test-lb"

}

## 외부에 80번 포트를 여는 보안 그룹을 생성합니다

resource "aws_security_group" "lb" {

name = "${local.lb_name}-sg"

vpc_id = aws_vpc.this.id

ingress {

from_port = 80

to_port = 80

protocol = "tcp"

cidr_blocks = ["0.0.0.0/0"]

}

}

## HTTP 요청을 분산하는 어플리케이션 로드 밸런서를 정의합니다

resource "aws_lb" "this" {

name = local.lb_name

internal = false

load_balancer_type = "application"

security_groups = [aws_security_group.lb.id]

subnets = aws_subnet.public[*].id # 퍼블릭 서브넷에 배치합니다

}

## 로드 밸런서로 온 요청을 받아 처리할 목표 그룹을 정의합니다

resource "aws_lb_target_group" "this" {

name = local.app_name

port = 3000 # 우리가 만든 컨테이너는 3000번 포트에서 입력을 받습니다

protocol = "HTTP"

target_type = "ip"

vpc_id = aws_vpc.this.id

}

## HTTP(80)에 대한 리스너를 생성합니다.

resource "aws_lb_listener" "http" {

load_balancer_arn = aws_lb.this.arn

port = "80"

protocol = "HTTP"

# 앞서 정의한 타겟 그룹으로 모든 트래픽을 보냅니다

default_action {

type = "forward"

target_group_arn = aws_lb_target_group.this.arn

}

}

이렇게 생성된 로드 밸런서는 simon-test-lb-135798642.ap-northeast-2.elb.amazonaws.com와 같은 주소를 할당받게 됩니다. 아직 이전에 만든 ECS 태스크가 타겟 그룹에 등록되지 않았기 때문에, 이 주소에 접속해보면 503 에러가 발생합니다. 두가지 추가 작업이 필요합니다.

우선 ECS 태스크가 3000번 포트에서의 입력을 처리할 수 있도록 해야 합니다.

## ECS는 로드 밸런서에서 3000번 포트로 온 요청을 받을 수 있습니다.

resource "aws_security_group_rule" "ecs_from_lb" {

security_group_id = aws_security_group.this.id

type = "ingress"

from_port = 3000

to_port = 3000

protocol = "tcp"

source_security_group_id = aws_security_group.lb.id

}

또 로드 밸런서에서 ECS 태스크로 요청도 가능해야 합니다.

## 로드 밸런서에서 ECS의 3000번 포트로 요청을 보낼 수 있습니다.

resource "aws_security_group_rule" "lb_to_ecs" {

security_group_id = aws_security_group.lb.id

type = "egress"

from_port = 3000

to_port = 3000

protocol = "tcp"

source_security_group_id = aws_security_group.this.id

}

다음으로는 ECS 서비스 정의를 변경해 태스크가 만들어지면 타겟 그룹에 등록하게 하게 하면 됩니다.

resource "aws_ecs_service" "this" {

desired_count = 1

name = local.app_name

cluster = aws_ecs_cluster.this.arn

task_definition = aws_ecs_task_definition.this.arn

launch_type = "FARGATE"

network_configuration {

subnets = aws_subnet.private[*].id

security_groups = [aws_security_group.this.id]

}

# 다음을 추가합니다.

load_balancer {

target_group_arn = aws_lb_target_group.this.arn

container_name = "app"

container_port = 3000

}

}

이제 로드 밸런서 주소로 요청을 보내면 로컬과 마찬가지로 응답을 보내옵니다.

$ curl simon-test-lb-135798642.ap-northeast-2.elb.amazonaws.com --data 'hello world'

hello world

남은 작업

실제 서비스에 더 가까우려면 추가로 해줘야 할 것들이 많이 있습니다. 다만 이번글에서는 따로 설명하지 않겠습니다.

- 로드 밸런서 주소는 랜덤하게 생성됩니다. 이를 실제 서비스에서 쓰기는 어렵고 서비스만의 도메인을 설정해주는게 좋습니다. Route53에 별칭 A 레코드를 생성하면 됩니다.

- 여기서는 HTTP 트래픽을 받고 있지만, 안전한 통신을 위해 HTTPS를 사용하면 좋습니다. AWS Certificate Manager로 인증서를 생성해 로드 밸런서에 설정하면 로드 밸런서에서 TLS 종료를 처리해줍니다. 그 뒷단에 있는 우리의 어플리케이션에서는 HTTP만 처리하면 됩니다.

- 현재 트래픽을 받을 수 있는 서버가 하나 뿐입니다. 서버만 늘리면 로드 밸런서가 알아서 트래픽을 분산해줍니다. desired_count를 조절해 수동으로 서버를 늘릴 수도 있고, 오토 스케일링 정책을 설정해 트래픽에 따라 서버를 늘이고 줄일 수도 있습니다.

- 현재는 컨테이너에서 발생한 로그를 볼 수 없습니다. CloudWatch Logs를 연결해 로그를 기록할 수 있습니다.

- CloudFront를 연결하면 전세계에서 접근할 때 지연 시간을 줄이는 등 추가 이득을 얻을 수 있습니다.

Appendix

- 예제 파일: simon-sample.zip

전체 Terraform 파일에서 한번에 스택을 생성할 때는 먼저 ECR만 생성해(

terraform apply --target aws_ecr_repository.simon_sample) 이미지를 올린 후 나머지를 생성해주는게 깔끔합니다. - 퍼블릭 및 프라이빗 서브넷이 있는 VPC(NAT)

- Amazon Elastic Container Service 설명서

- ELB 로드 밸런서로 트래픽 라우팅

- Application Load Balancer용 HTTPS 리스너 생성